コンテキストウィンドウ:AIの「メモリー」

ChatGPTのような大規模言語モデル(LLM)とやり取りするとき、進行中の会話内で過去のメッセージを本当に記憶しています。この能力は主にコンテキストウィンドウによるものです。

LLM理解の核心

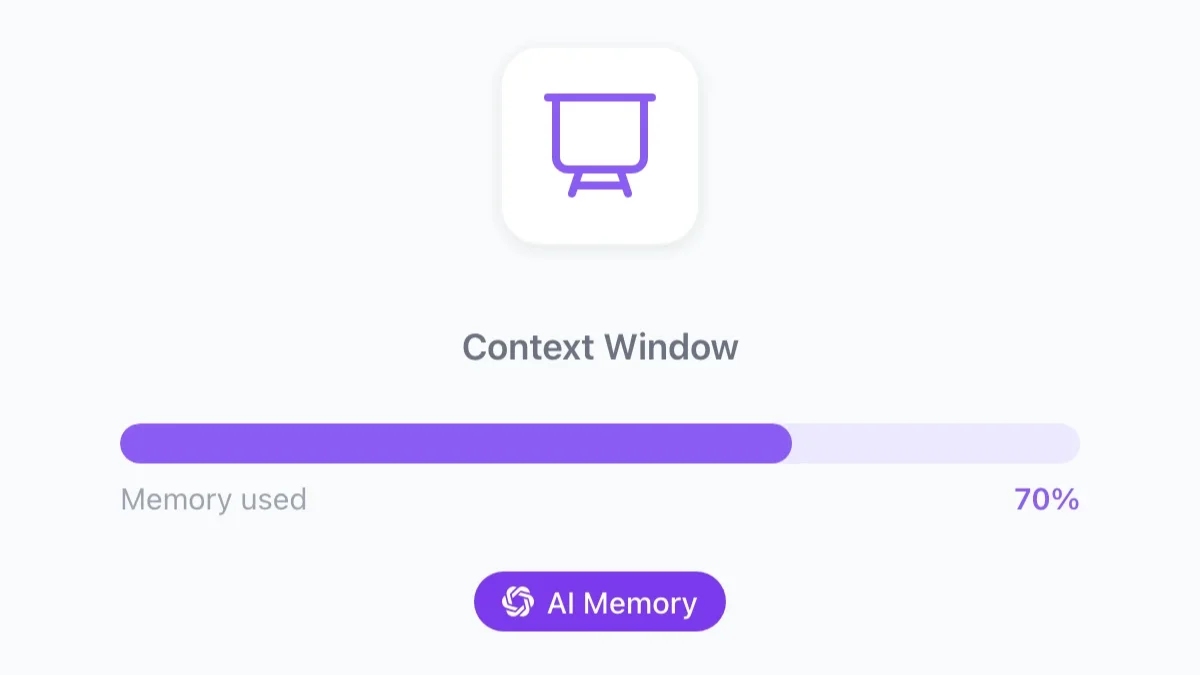

ChatGPTのような大規模言語モデル(LLM)とやり取りするとき、進行中の会話内で過去のメッセージを本当に記憶しています。この能力は主に「コンテキストウィンドウ」と呼ばれるものによるものです。AIモデルのワーキングメモリは、人間の短期記憶やコンピュータのRAMに類似しています。

簡単に言えば、コンテキストウィンドウを、AIが同時に「読む」ことができ「頭に入れておく」ことができるテキストの量と想像してください。このウィンドウが大きいほど、AIは会話からより多くの詳細を記憶したり、以前に言ったことを「忘れる」ことなく長い文書を分析したりできます。

コンテキストウィンドウとは?

単語を処理する人間とは異なり、LLMはテキストを「トークン」に分解します。トークンは、単一の文字、単語の一部、単語全体、あるいは短いフレーズになることがあります。

コンテキストウィンドウのサイズは常にトークンで測定されます。平均して、英語の単語は約1.5トークンです。コンテキストウィンドウはテキストだけに使用されるわけではないことに注意が重要です。システム命令、RAG(検索拡張生成)のための追加情報、フォーマットなどの要素も含まれます。

なぜそれほど重要なのか?

大きなコンテキストウィンドウはLLMに重要な利点を提供します:

情報保持の改善:AIは会話を通じてより多くの詳細を記憶でき、「見失う」ことを防ぎます。

より長いテキストの処理:モデルははるかに大きな文書、コードベース、データセットを分析・要約できます。

高度な推論:コンテキストの増加により、より正確で複雑で微妙な応答が可能になります。

新しいインタラクションの可能性:データ処理能力の増加により、AIとのまったく新しいやり取り方法が開かれます。

大きなコンテキストウィンドウの課題

利点にもかかわらず、大きなコンテキストウィンドウには課題があります:

計算コストとパワー:より大きなテキストブロックの処理には、大幅に多くの計算能力、メモリ、時間が必要です。

レイテンシ:コンテキスト長が増加するにつれて推論が遅くなる可能性があります。

「干し草の中の針」問題:テキストの量が増えると、モデルは特定の重要な詳細を正確に見つけるのに苦労する可能性があります。

能力の進化

コンテキストウィンドウのサイズは時間とともに大幅に成長してきました。GPT-2のような初期のLLMが約2,048トークンに制限されていたのに対し、現代のモデルは能力が爆発的に増加しています。

今日、AnthropicのClaude 3は200,000トークンのウィンドウを提供しています。OpenAIのGPT-4 TurboとGPT-4oは128,000トークンに達しています。

パワーと実用性のバランス

コンテキストウィンドウは大規模言語モデルの「メモリー」と理解の基本です。コンテキストウィンドウの理解はGPT Workspaceにとって特に重要で、現在のモデルであるGPT-4.1とGPT-4oが一度に記憶・処理できる情報量に直接影響します。

Google Workspaceで大きなコンテキストウィンドウを体験しましょう。 GPT Workspaceをインストールして、128kコンテキストのGPT-4oをGoogle Docs、Sheets、Slides、Gmailで直接使用できます。