OpenAI GPT-tokens begrijpen: een uitgebreide gids

Ontdek de kracht van OpenAI GPT-tokens in deze uitgebreide gids. Leer wat tokens zijn, hoe je ze telt en hoe je ze gebruikt om samenhangende en contextueel relevante tekst te genereren met OpenAI GPT-m

OpenAI GPT-modellen behoren tot de krachtigste taalmodellen die momenteel beschikbaar zijn, met de mogelijkheid om zeer samenhangende en contextueel relevante tekst te genereren. Deze modellen gebruiken tokens als de basiseenheid om de lengte van een tekst te berekenen. Maar wat zijn tokens precies en hoe werken ze? In deze gids duiken we in de details van OpenAI GPT-tokens, bespreken we hun definitie, methoden om ze te tellen en hun praktische toepassingen.

OpenAI GPT-tokens begrijpen

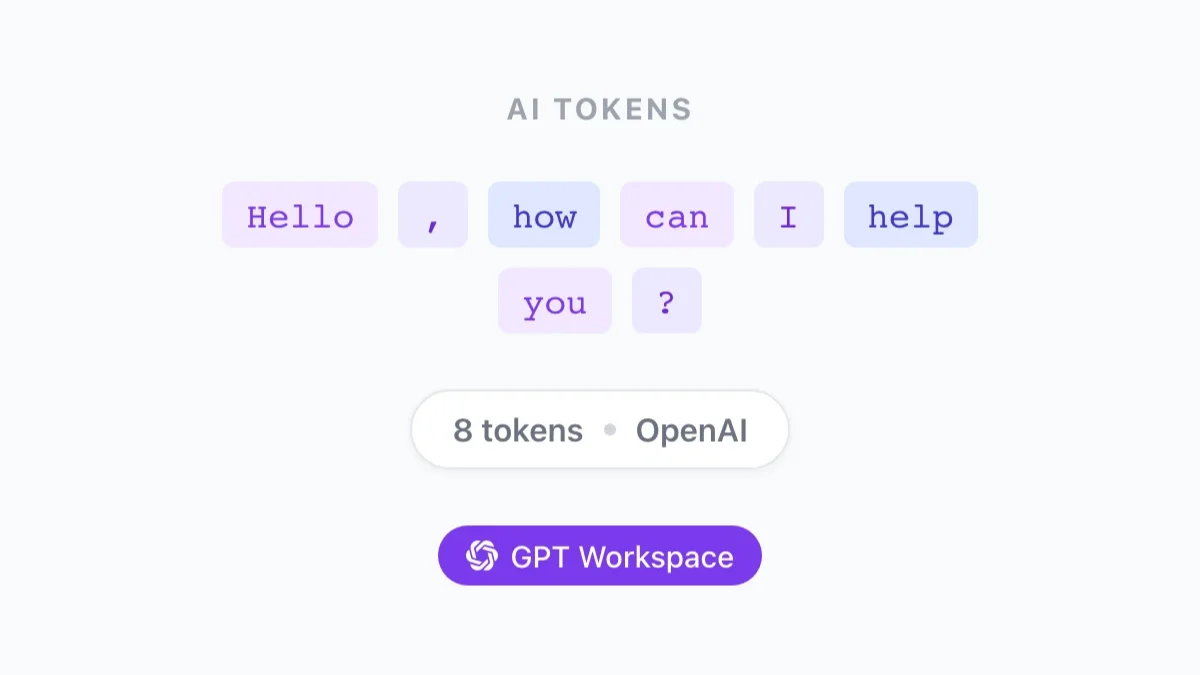

Tokens in de context van OpenAI GPT-modellen zijn clusters van tekens die de fundamentele eenheid van tekst vertegenwoordigen. Deze tokens worden gegenereerd door een tokenizer-algoritme dat tekst in kleinere segmenten verdeelt volgens bepaalde regels, zoals spaties, leestekens en speciale tekens. Tokens kunnen soms overeenkomen met woorden, maar niet altijd, omdat de tokenizer alle tekens, inclusief emoji’s, als potentiële tokens beschouwt.

Tokens tellen in je tekst

Om het aantal tokens in je tekst te bepalen, moet je deze tokeniseren met behulp van een tokenizer-algoritme. OpenAI biedt een officiële tokenizer die je hierbij kan helpen. Het aantal tokens dat door de tokenizer wordt geproduceerd, is afhankelijk van de taal en het specifieke model dat wordt gebruikt. Als algemene richtlijn kun je echter de volgende woord-naar-token-verhoudingen gebruiken:

- Engels: 1 woord ≈ 1,3 tokens

- Spaans: 1 woord ≈ 2 tokens

- Frans: 1 woord ≈ 2 tokens

Het is cruciaal om te erkennen dat leestekens als één token worden geteld, terwijl speciale tekens en emoji’s respectievelijk als één tot drie tokens en twee tot drie tokens kunnen worden geteld.

Praktische toepassing van tokens

In OpenAI GPT-modellen worden tokens gebruikt in combinatie met de max_tokens-parameter voor tekstgeneratie. De max_tokens-parameter bepaalt het maximale aantal tokens dat moet worden gegenereerd in elk API-verzoek. De waarde van max_tokens moet altijd voldoen aan de volgende beperking: prompt_tokens + max_tokens ≤ model limiet, waarbij prompt_tokens het aantal tokens in de prompt aangeeft.

De kosten van een token zijn afhankelijk van het specifieke model dat wordt gebruikt, en ze worden gefactureerd per 1000 tokens. De prijs van 1000 tokens voor ChatGPT is bijvoorbeeld USD 0,0020, terwijl deze voor GPT-4 32k context USD 0,1200 is.

Conclusie

Tokens zijn een fundamenteel concept in OpenAI GPT-modellen, dat de basiseenheid van tekst symboliseert die wordt gebruikt om contextueel relevante en samenhangende tekst te genereren. Door de aard van tokens en hun praktisch gebruik te begrijpen, kun je het volledige potentieel van OpenAI GPT-modellen benutten en boeiende inhoud creëren die je publiek betrekt en informeert.

Wil je GPT-modellen direct in Google Workspace gebruiken? Installeer GPT Workspace — de Google Workspace add-on die OpenAI GPT naar Google Docs, Sheets, Slides en Gmail brengt, gratis.