OpenAI GPT-Tokens verstehen: Ein umfassender Leitfaden

Entdecken Sie die Leistungsfähigkeit von OpenAI GPT-Tokens in diesem umfassenden Leitfaden. Erfahren Sie, was Tokens sind, wie man sie zählt und wie man sie nutzt, um kohärenten und kontextrelevanten Text mit OpenAI GPT-Modellen zu generieren.

OpenAI GPT-Modelle gehören zu den leistungsstärksten Sprachmodellen, die heute verfügbar sind, und sind in der Lage, hochgradig kohärenten und kontextuell relevanten Text zu erzeugen. Diese Modelle verwenden Tokens als Grundeinheit, um die Länge eines Textes zu berechnen. Aber was genau sind Tokens und wie funktionieren sie? In diesem Leitfaden gehen wir ins Detail zu OpenAI GPT-Tokens, besprechen ihre Definition, Methoden zu ihrer Zählung und ihre praktischen Anwendungen.

OpenAI GPT-Tokens verstehen

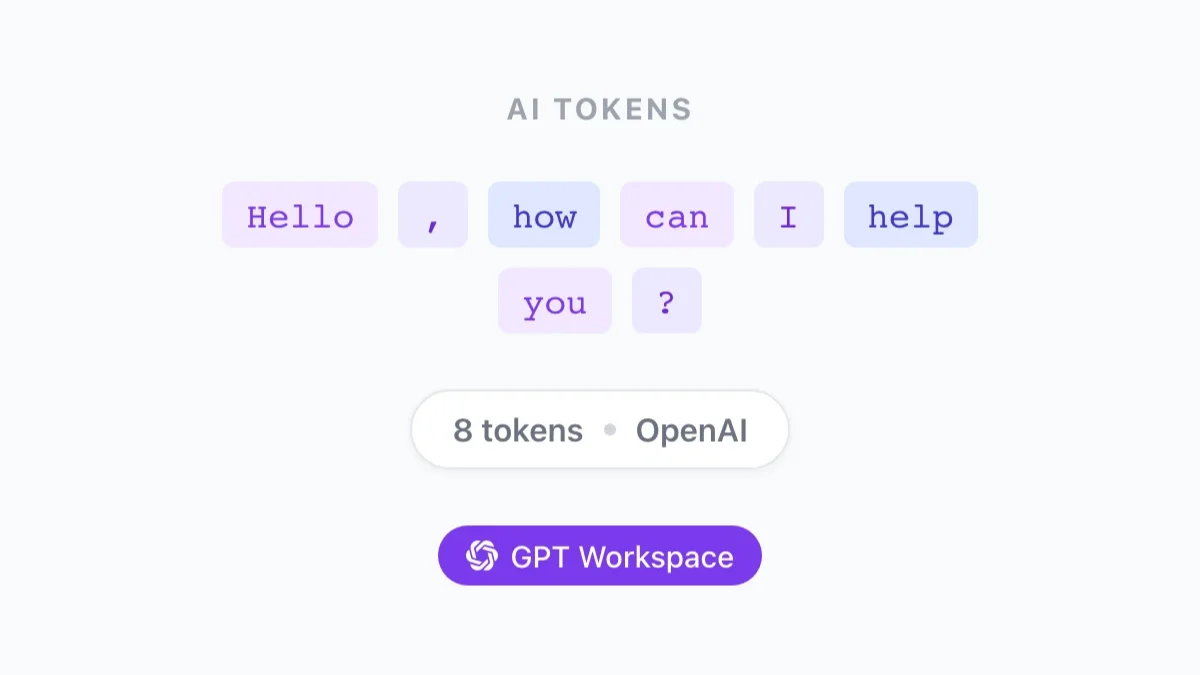

Tokens im Kontext von OpenAI GPT-Modellen sind Zeichengruppen, die die grundlegende Texteinheit darstellen. Diese Tokens werden von einem Tokenisierungsalgorithmus erzeugt, der Text nach bestimmten Regeln in kleinere Segmente aufteilt, wie z.B. Leerzeichen, Satzzeichen und Sonderzeichen. Tokens können manchmal Wörtern entsprechen, aber nicht immer, da der Tokenisierer alle Zeichen, einschließlich Emojis, als potenzielle Tokens betrachtet.

Tokens in Ihrem Text zählen

Um die Anzahl der Tokens in Ihrem Text zu ermitteln, müssen Sie ihn mit einem Tokenisierungsalgorithmus tokenisieren. OpenAI stellt einen offiziellen Tokenizer bereit, der Sie bei diesem Prozess unterstützen kann. Die Anzahl der vom Tokenizer erzeugten Tokens hängt von der Sprache und dem spezifisch verwendeten Modell ab. Als allgemeine Richtlinie können Sie jedoch die folgenden Wort-zu-Token-Verhältnisse verwenden:

- Englisch: 1 Wort ≈ 1,3 Tokens

- Spanisch: 1 Wort ≈ 2 Tokens

- Französisch: 1 Wort ≈ 2 Tokens

Es ist wichtig zu beachten, dass Satzzeichen als ein Token gezählt werden, während Sonderzeichen und Emojis als ein bis drei Tokens bzw. zwei bis drei Tokens gezählt werden können.

Praktische Anwendung von Tokens

In OpenAI GPT-Modellen werden Tokens in Verbindung mit dem max_tokens-Parameter für die Textgenerierung verwendet. Der max_tokens-Parameter legt die maximale Anzahl von Tokens fest, die in einer API-Anfrage generiert werden sollen. Der Wert von max_tokens sollte immer der folgenden Einschränkung entsprechen: prompt_tokens + max_tokens ≤ Modelllimit, wobei prompt_tokens die Anzahl der Tokens im Prompt bezeichnet.

Die Kosten eines Tokens hängen vom spezifisch verwendeten Modell ab und werden pro 1000 Tokens abgerechnet. Beispielsweise beträgt der Preis für 1000 Tokens bei ChatGPT USD 0,0020, während er für GPT-4 32k context USD 0,1200 beträgt.

Fazit

Tokens sind ein grundlegendes Konzept in OpenAI GPT-Modellen und symbolisieren die Basiseinheit des Textes, die verwendet wird, um kontextrelevanten und kohärenten Text zu generieren. Indem Sie die Natur von Tokens und ihre praktische Nutzung verstehen, können Sie das volle Potenzial von OpenAI GPT-Modellen ausschöpfen und fesselnde Inhalte erstellen, die Ihr Publikum ansprechen und informieren.

Möchten Sie GPT-Modelle direkt in Google Workspace nutzen? Installieren Sie GPT Workspace — das Google Workspace Add-on, das OpenAI GPT kostenlos zu Google Docs, Sheets, Slides und Gmail bringt.