Comprendre les Tokens OpenAI GPT : Un Guide Complet

Découvrez la puissance des tokens OpenAI GPT dans ce guide complet. Apprenez ce que sont les tokens, comment les compter et comment les utiliser pour générer du texte cohérent et contextuellement pertinent avec les modèles GPT d'OpenAI.

Les modèles OpenAI GPT comptent parmi les modèles de langage les plus puissants disponibles aujourd’hui, avec la capacité de générer du texte hautement cohérent et contextuellement pertinent. Ces modèles utilisent les tokens comme unité élémentaire pour calculer la longueur d’un texte. Mais que sont exactement les tokens et comment fonctionnent-ils ? Dans ce guide, nous approfondirons les détails des tokens OpenAI GPT, en discutant de leur définition, des méthodes pour les compter et de leurs applications pratiques.

Comprendre les Tokens OpenAI GPT

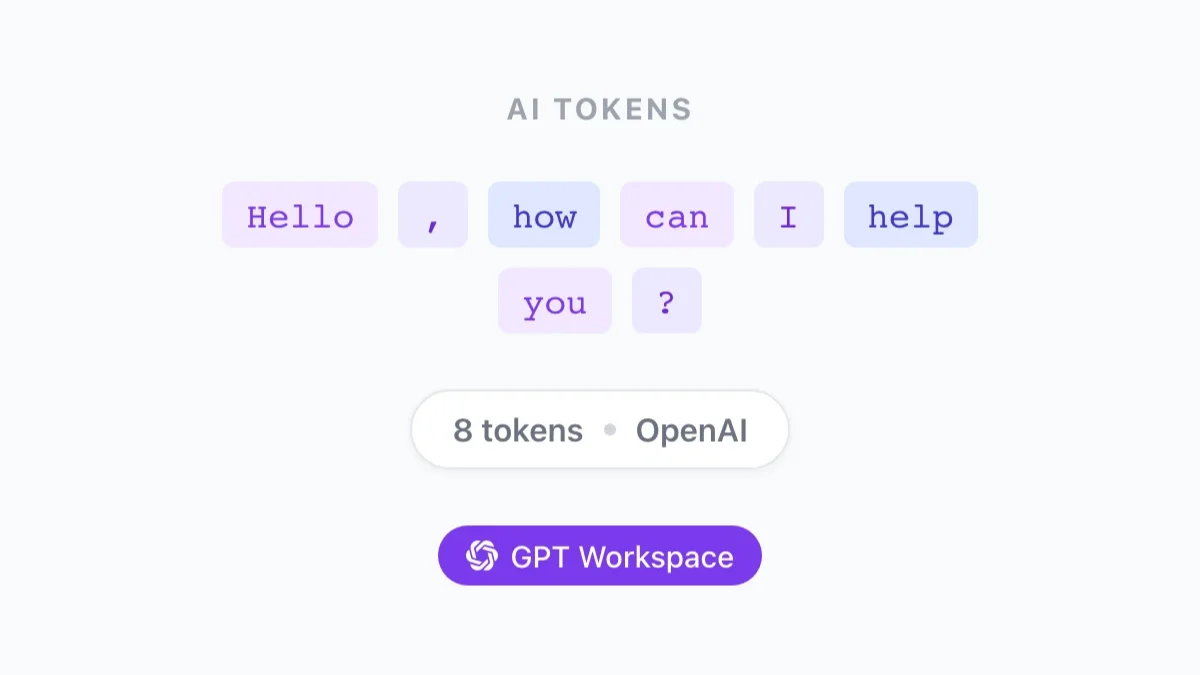

Les tokens dans le contexte des modèles OpenAI GPT sont des groupes de caractères représentant l’unité fondamentale du texte. Ces tokens sont générés par un algorithme de tokenisation qui segmente le texte en segments plus petits selon certaines règles, telles que les espaces, les signes de ponctuation et les caractères spéciaux. Les tokens peuvent parfois correspondre à des mots, mais pas toujours, car le tokeniseur considère tous les caractères, y compris les emojis, comme des tokens potentiels.

Compter les Tokens dans Votre Texte

Pour déterminer le nombre de tokens dans votre texte, vous devez le tokeniser à l’aide d’un algorithme de tokenisation. OpenAI fournit un tokeniseur officiel qui peut vous aider dans ce processus. Le nombre de tokens produits par le tokeniseur dépendra de la langue et du modèle spécifique utilisé. Cependant, comme guide général, vous pouvez utiliser les ratios mots-tokens suivants :

- Anglais : 1 mot ≈ 1,3 tokens

- Espagnol : 1 mot ≈ 2 tokens

- Français : 1 mot ≈ 2 tokens

Il est crucial de reconnaître que les signes de ponctuation sont comptés comme un token, tandis que les caractères spéciaux et les emojis peuvent être comptés respectivement comme un à trois tokens et deux à trois tokens.

Application Pratique des Tokens

Dans les modèles OpenAI GPT, les tokens trouvent leur utilité en conjonction avec le paramètre max_tokens pour la génération de texte. Le paramètre max_tokens stipule le nombre maximum de tokens devant être générés dans toute requête API. La valeur de max_tokens doit toujours respecter la contrainte suivante : prompt_tokens + max_tokens ≤ limite du modèle, où prompt_tokens désigne le nombre de tokens dans le prompt.

Le coût d’un token dépendra du modèle spécifique utilisé, et il est facturé par tranche de 1000 tokens. Par exemple, le prix de 1000 tokens pour ChatGPT est de 0,0020 USD, tandis que pour GPT-4 avec un contexte de 32k, il est de 0,1200 USD.

Conclusion

Les tokens sont un concept fondamental dans les modèles OpenAI GPT, symbolisant l’unité de base du texte utilisée pour générer du texte contextuellement pertinent et cohérent. En comprenant la nature des tokens et leur utilisation pratique, vous pouvez exploiter tout le potentiel des modèles OpenAI GPT et créer du contenu captivant qui engage et éduque votre audience.

Vous voulez utiliser les modèles GPT directement dans Google Workspace ? Installez GPT Workspace — le module complémentaire Google Workspace qui intègre OpenAI GPT à Google Docs, Sheets, Slides et Gmail gratuitement.