Kontextfönstret: Din AI:s "minne"

Kärnan i LLM-förståelse När du interagerar med en stor språkmodell (LLM) som ChatGPT kommer den faktiskt ihåg dina tidigare meddelanden inom den pågående konversationen. Denna förmåga beror främst på

Kärnan i LLM-förståelse

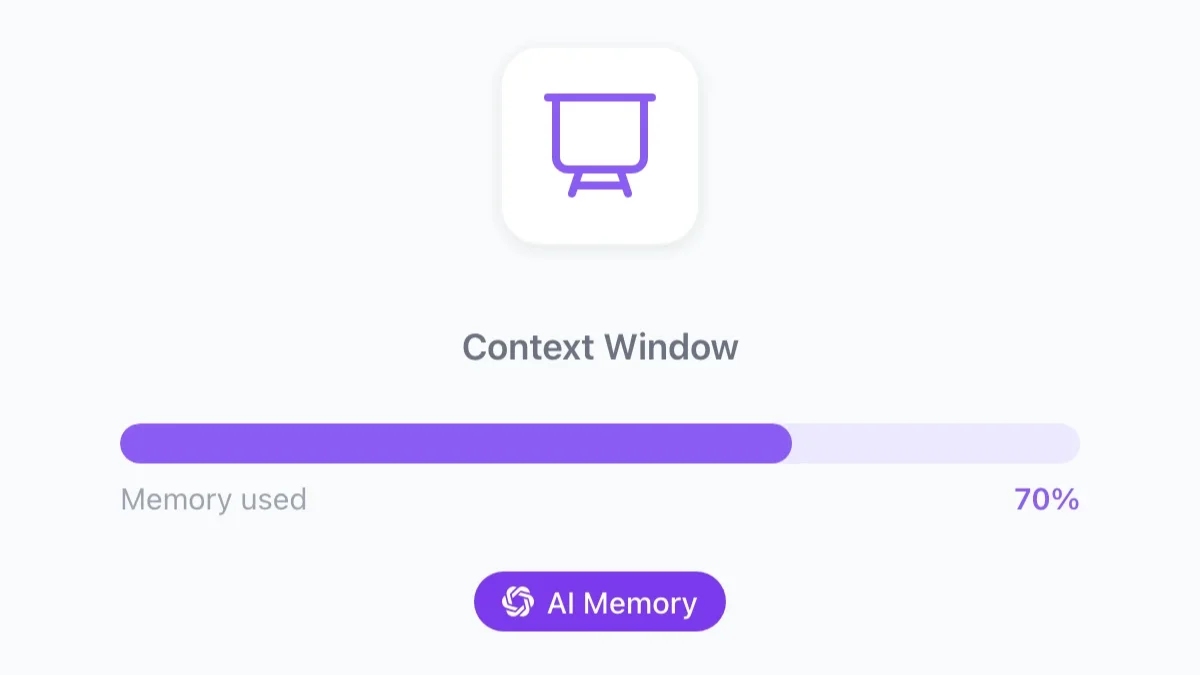

När du interagerar med en stor språkmodell (LLM) som ChatGPT kommer den faktiskt ihåg dina tidigare meddelanden inom den pågående konversationen. Denna förmåga beror främst på vad som kallas “kontextfönstret”. AI-modellens arbetsminne är analogt med mänskligt korttidsminne eller en dators RAM. Precis som korttidsminnet hjälper oss att hålla och bearbeta information tillfälligt, och RAM låter en dator snabbt komma åt den data den behöver i stunden, bestämmer en AI:s arbetsminne hur mycket information den kan hantera åt gången. Denna kapacitet begränsar hur mycket kontext AI:n kan ta hänsyn till när den svarar på frågor, ungefär som vårt korttidsminne eller en dators RAM sätter gränser för vad som kan bearbetas samtidigt.

Enkelt uttryckt, föreställ dig kontextfönstret som mängden text som AI:n kan “läsa” och “hålla i minnet” samtidigt. Ju större detta fönster är, desto fler detaljer kan AI:n komma ihåg från din konversation eller analysera från långa dokument utan att “glömma” vad som sagts tidigare.

Vad är kontextfönstret?

Till skillnad från människor som bearbetar ord, bryter LLM:er ner text i “tokens”. En token kan vara ett enskilt tecken, en del av ett ord, ett helt ord eller till och med en kort fras. Till exempel kan ordet “amoral” ha två tokens: “a” och “moral”.

Storleken på kontextfönstret mäts alltid i tokens. I genomsnitt är ett engelskt ord ungefär 1,5 tokens. Det är viktigt att notera att kontextfönstret inte enbart används för din text; det inkluderar också element som systeminstruktioner (kallade “system prompts”), ytterligare information för Retrieval Augmented Generation (RAG) och formatering. En system prompt är en instruktion som ges till AI:n för att styra hur den ska bete sig eller svara. Till exempel, om du ber AI:n att svara på ett professionellt sätt, är det kommandot en system prompt: “Var vänlig svara på alla frågor i en professionell och artig ton.”

Varför är det så viktigt?

Ett större kontextfönster erbjuder betydande fördelar för LLM:er:

Förbättrad informationsretention: AI:n kan komma ihåg fler detaljer under hela en konversation, vilket förhindrar att den “tappar tråden”.

Bearbetning av längre texter: Modeller kan analysera och sammanfatta mycket större dokument, kodbaser eller dataset, vilket tidigare var omöjligt.

Avancerat resonemang: Ökad kontext möjliggör mer exakta, komplexa och nyanserade svar. Till exempel kunde Googles Gemini 1.5 Pro-modell lära sig att översätta ett kritiskt utrotningshotat språk (Kalamang) genom att läsa dess enda grammatikmanual, vilket visade översättningsförmåga jämförbar med en människa.

Nya interaktionsmöjligheter: Den ökade datahanteringskapaciteten öppnar upp helt nya sätt för användare att interagera med AI, vilket möjliggör mer komplexa och omfattande uppgifter.

Utmaningar med stora kontextfönster

Trots sina fördelar medför stora kontextfönster utmaningar:

Beräkningskostnad och kraft: Att bearbeta större textblock kräver betydligt mer beräkningskraft, minne och tid. Att fördubbla kontextlängden kan fyrdubbla det beräkningsbehovet.

Latens: Inferensen kan bli långsammare när kontextlängden ökar, vilket är problematiskt för realtidsapplikationer.

“Nålen i höstacken”-problemet: När textvolymen (“höstacken”) växer kan en modell få svårt att lokalisera en specifik, avgörande detalj (“nålen”). Dess uppmärksamhet späds ut, vilket får den att förbise det viktiga faktumet – som att missa en enda mening om ett projekts kritiska misslyckande inom en 200-sidig rapport. Detta minskar drastiskt modellens tillförlitlighet och noggrannhet.

För en djupare förståelse, se den grundläggande artikeln om detta problem: https://arxiv.org/abs/2307.03172

Evolutionen av kapaciteter

Kontextfönsterstorlekar har vuxit betydligt över tiden, vilket markerar ett stort steg mot djupare förståelse och bredare situationsmedvetenhet i AI-system. Medan tidiga LLM:er som GPT-2 var begränsade till cirka 2 048 tokens, har moderna modeller sett en explosion i sina kapaciteter.

Idag erbjuder modeller som Anthropics Claude 3 ett 200 000-tokensfönster. OpenAIs GPT-4 Turbo och GPT-4o når 128 000 tokens. Google Gemini 1.5 Pro har ett standardfönster på 128 000 tokens, med en experimentell version som går upp till 1 miljon tokens, och forskning som testar upp till 10 miljoner tokens. Projekt som Magic AI siktar till och med på 100 miljoner tokens. Denna kapplöpning att öka kontexten är en nyckelfaktor för innovation och konkurrens inom AI-fältet.

Följande tabell illustrerar evolutionen av kontextfönsterkapaciteter:

| Kontextfönster (tokens) | Lanseringsår | Modell | Beskrivning |

|---|---|---|---|

| 2 048 | 2019 | GPT-2 | Tidig LLM, begränsad kontext |

| 4 096 | 2020 | GPT-3 | Betydande ökning |

| 8 192 | 2022 | GPT-3.5 Turbo | Ytterligare förbättring |

| 32 768 | 2023 | GPT-4 | Stort steg framåt |

| 128 000 | 2023 | GPT-4 Turbo | Optimerad, lägre kostnadsversion |

| 128 000 | 2024 | GPT-4o (Omni) | Multimodal (text, bild, ljud) |

| 1 000 000 (exp.) | 2024 | Gemini 1.5 Pro | Massivt kontextfönster |

| 200 000 | 2024 | Claude 3 Opus | Utökat kontext, starkt resonemang |

| 200 000+ | 2024 | Claude 3.5/4 | Senaste Anthropic-modeller |

| 128 000 / 1M (exp.) | 2024 | Gemini 1.5 Pro | Multimodal, stort kontextfönster |

| 128 000+ | 2024 | Gemini 2.0 / 2.5 Pro | Förbättrade kapaciteter |

Balansera kraft och praktisk användning

Kontextfönstret är grundläggande för “minnet” och förståelsen hos stora språkmodeller. Dess storlek, mätt i tokens, påverkar direkt en LLM:s förmåga att generera sammanhängande text och hantera komplexa uppgifter.

Även om större kontextfönster avsevärt förbättrar AI-kapaciteter, medför de betydande utmaningar relaterade till kostnad, prestanda och säkerhet. Framtida LLM-utveckling kommer att fortsätta att fokusera på att optimera denna kritiska komponent, i jakten på den “gyllene medelvägen” mellan processorkraft och praktisk användbarhet. Att förstå kontextfönstret är därför avgörande för alla som vill få ut det mesta av nuvarande och framtida AI-verktyg.

Att förstå kontextfönstret är särskilt relevant för GPT Workspace, eftersom det direkt påverkar hur mycket information våra nuvarande modeller – GPT-4.1 och GPT-4o – kan komma ihåg och bearbeta åt gången. Båda modellerna erbjuder ett betydande kontextfönster på upp till 128 000 tokens, vilket gör dem mycket praktiska för utökade diskussioner, dokumentanalys och komplexa arbetsflöden. Denna kapacitet gör det möjligt för användare att använda långa dokument eller interaktioner utan att ofta förlora tidigare kontext, vilket är avgörande för att upprätthålla sammanhängande, produktiva sessioner i GPT Workspace.

Upplev stora kontextfönster i Google Workspace. Installera GPT Workspace och använd GPT-4o med 128k kontext direkt i Google Docs, Sheets, Slides och Gmail.