Förstå OpenAI GPT-tokens: En omfattande guide

Upptäck kraften i OpenAI GPT-tokens i denna omfattande guide. Lär dig vad tokens är, hur man räknar dem och hur man använder dem för att generera sammanhängande och kontextuellt relevant text med OpenAI GPT-m

OpenAI GPT-modellerna står bland de mest kraftfulla språkmodellerna som finns tillgängliga idag, med förmågan att generera mycket sammanhängande och kontextuellt relevant text. Dessa modeller använder tokens som den grundläggande enheten för att beräkna längden på en text. Men vad exakt är tokens, och hur fungerar de? I denna guide kommer vi att fördjupa oss i detaljerna kring OpenAI GPT-tokens, diskutera deras definition, metoder för att räkna dem och deras praktiska tillämpningar.

Förstå OpenAI GPT-tokens

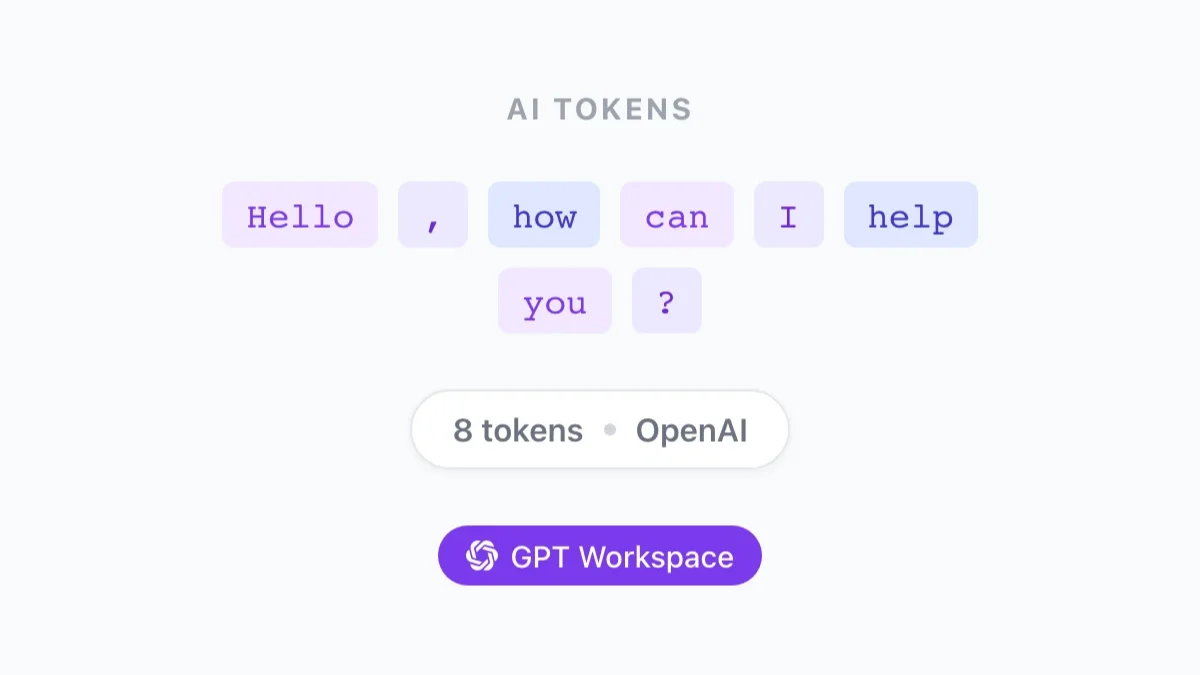

Tokens i sammanhanget med OpenAI GPT-modeller är kluster av tecken som representerar den grundläggande textenheten. Dessa tokens genereras av en tokenizer-algoritm som delar upp text i mindre segment enligt vissa regler, såsom mellanslag, skiljetecken och specialtecken. Tokens kan ibland motsvara ord, men inte alltid, eftersom tokenizern tar hänsyn till alla tecken, inklusive emojis, som potentiella tokens.

Räkna tokens i din text

För att fastställa antalet tokens i din text måste du tokenisera den med hjälp av en tokenizer-algoritm. OpenAI tillhandahåller en officiell tokenizer som kan hjälpa dig i denna process. Antalet tokens som produceras av tokenizern kommer att bero på språket och den specifika modell som används. Men som en allmän riktlinje kan du använda följande ord-till-token-förhållanden:

- Engelska: 1 ord ≈ 1,3 tokens

- Spanska: 1 ord ≈ 2 tokens

- Franska: 1 ord ≈ 2 tokens

Det är avgörande att erkänna att skiljetecken räknas som en token, medan specialtecken och emojis kan räknas som en till tre tokens respektive två till tre tokens.

Praktisk tillämpning av tokens

I OpenAI GPT-modeller används tokens tillsammans med parametern max_tokens för textgenerering. Parametern max_tokens anger det maximala antalet tokens som ska genereras i varje API-förfrågan. Värdet på max_tokens bör alltid följa följande begränsning: prompt_tokens + max_tokens ≤ modellgräns, där prompt_tokens anger antalet tokens i prompten.

Kostnaden för en token beror på den specifika modell som används, och den faktureras per 1000 tokens. Till exempel är priset för 1000 tokens för ChatGPT USD 0,0020, medan det för GPT-4 32k context är USD 0,1200.

Slutsats

Tokens är ett grundläggande koncept i OpenAI GPT-modeller, som symboliserar den grundläggande textenheten som används för att generera kontextuellt relevant och sammanhängande text. Genom att förstå innebörden av tokens och deras praktiska användning kan du låsa upp den fulla potentialen hos OpenAI GPT-modeller och skapa engagerande innehåll som fångar och utbildar din publik.

Vill du använda GPT-modeller direkt i Google Workspace? Installera GPT Workspace — Google Workspace-tillägget som tar med OpenAI GPT till Google Docs, Sheets, Slides och Gmail gratis.