Entendendo os Tokens do OpenAI GPT: Um Guia Completo

Descubra o poder dos tokens do OpenAI GPT neste guia completo. Aprenda o que são tokens, como contá-los e como usá-los para gerar texto coerente e contextualmente relevante com os modelos GPT da OpenAI.

Os modelos OpenAI GPT estão entre os modelos de linguagem mais potentes disponíveis atualmente, com a capacidade de gerar texto altamente coerente e contextualmente pertinente. Esses modelos empregam tokens como a unidade elementar para calcular o comprimento de um texto. Mas o que exatamente são tokens e como funcionam? Neste guia, vamos aprofundar os detalhes dos tokens OpenAI GPT, discutindo sua definição, métodos para contá-los e suas aplicações práticas.

Entendendo os Tokens do OpenAI GPT

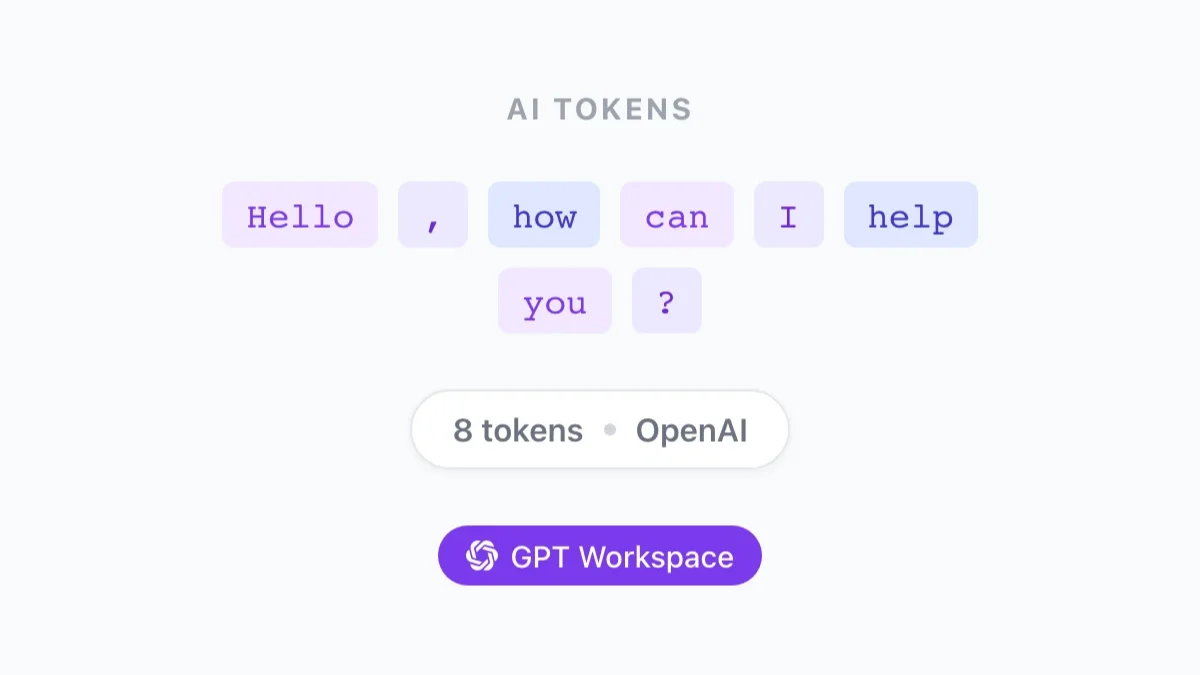

Tokens no contexto dos modelos OpenAI GPT são grupos de caracteres que representam a unidade fundamental do texto. Esses tokens são gerados por um algoritmo tokenizador que segrega o texto em segmentos menores seguindo certas regras, como espaços, sinais de pontuação e caracteres especiais. Os tokens às vezes podem corresponder a palavras, mas nem sempre, pois o tokenizador contempla todos os caracteres, incluindo emojis, como tokens potenciais.

Contando Tokens no Seu Texto

Para determinar o número de tokens no seu texto, você deve tokenizá-lo usando um algoritmo tokenizador. A OpenAI fornece um tokenizador oficial que pode ajudá-lo nesse processo. O número de tokens produzidos pelo tokenizador dependerá do idioma e do modelo específico usado. No entanto, como guia geral, você pode usar as seguintes proporções de palavras para tokens:

- Inglês: 1 palavra ≈ 1,3 tokens

- Espanhol: 1 palavra ≈ 2 tokens

- Francês: 1 palavra ≈ 2 tokens

É crucial reconhecer que os sinais de pontuação são contados como um token, enquanto caracteres especiais e emojis podem ser contados como um a três tokens e dois a três tokens, respectivamente.

Aplicação Prática dos Tokens

Nos modelos OpenAI GPT, os tokens encontram seu uso em conjunto com o parâmetro max_tokens para geração de texto. O parâmetro max_tokens estipula o número máximo de tokens que devem ser gerados em qualquer requisição de API. O valor de max_tokens deve sempre aderir à seguinte restrição: prompt_tokens + max_tokens ≤ limite do modelo, onde prompt_tokens denota o número de tokens no prompt.

O custo de um token dependerá do modelo específico usado, e é cobrado por 1000 tokens. Por exemplo, o preço de 1000 tokens para ChatGPT é USD 0,0020, enquanto para GPT-4 com contexto de 32k, é USD 0,1200.

Conclusão

Os tokens são um conceito fundamental nos modelos OpenAI GPT, simbolizando a unidade básica de texto empregada para gerar texto contextualmente relevante e coerente. Ao compreender a natureza dos tokens e seu uso prático, você pode desbloquear todo o potencial dos modelos OpenAI GPT e criar conteúdo cativante que envolva e eduque sua audiência.

Quer usar os modelos GPT diretamente no Google Workspace? Instale o GPT Workspace — o complemento do Google Workspace que traz o OpenAI GPT para Google Docs, Sheets, Slides e Gmail gratuitamente.